如果您是数据中心运营商,想必曾思考过一个关键问题:我能否对现有的风冷数据中心进行改造,使其采用液冷技术,成为一座可正常运行的液冷数据中心?答案很明确:可以。但要实现有效改造,需要周密规划、核查硬件兼容性,并让改造方案与您的业务目标保持一致。

在本指南中,我将向您介绍从空气冷却转为液体冷却所需的一切知识,包括可行性检查、分步方法和成本考虑。.

将风冷数据中心改造为液体冷却是否可行?

每个运营商首先都想知道是否可以进行改造,答案几乎都是肯定的,但也有一些注意事项。全球有超过 60% 的数据中心仍在使用传统的空气冷却技术,其中大部分都可以通过正确的方法改造成液体冷却数据中心。可行性实际上取决于三个核心因素,下面我将详细分析:

1.现有数据中心基础设施和布局

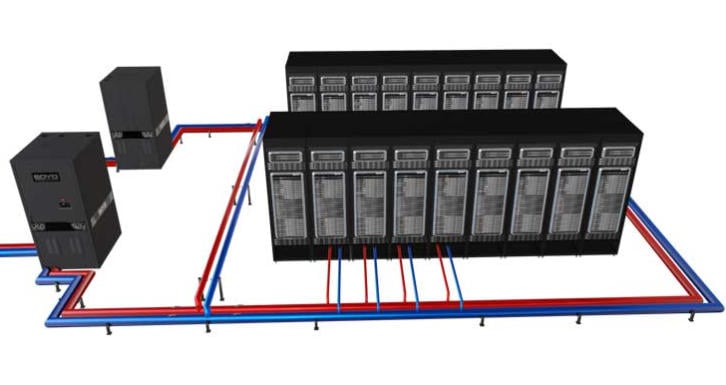

在向液体冷却过渡时,设备的物理布局和结构能力决定了成败。无论是冷板、浸入式还是混合式液体冷却系统,都需要空间来安装冷却剂分配装置 (CDU)、管道和热交换器,这些都是功能系统的重要组成部分。以下是您需要注意的事项:

液体冷却组件(尤其是浸入式水箱和 CDU)比传统的空气冷却设备更重。大多数现代数据中心都设计有可承受额外重量的加高地板,但老式设施可能需要进行结构升级,以满足 GB 50370 建筑负载标准,这是安全运行的关键要求。.

您需要为每个机架铺设冷却剂管道;这可能需要修改现有的电缆托架或在高架地板上开凿新的开口,所有这些都是升级为液冷数据中心的关键步骤。.

排热装置通常需要安装在屋顶或外墙,因此您需要确认结构的兼容性,并确保遵守当地的建筑法规,这些都是确保安全运行的关键步骤。.

2.硬件兼容性

业内专家一致认为,在将现有设施改造成液体冷却数据中心时,硬件兼容性往往是遇到的最大障碍。传统的风冷式服务器采用散热片和风扇,针对气流进行了优化,因此可能需要进行改造才能与液体冷却系统配合使用。下面是需要检查的内容:

大约有 80% 在用风冷服务器的散热器需要更换为与液体兼容的冷板,以支持常见的直接液体冷却方式。不过,一些较新的服务器已经 “液体就绪”,因此在建设设备时可能不需要对这些服务器进行全面的硬件更换。.

目前,液体冷却设备接口(如快速连接接头和管道尺寸)还没有通用标准。如果混合使用来自不同供应商的部件,可能会造成兼容性问题,从而延误改造。与单一供应商合作或使用标准化部件有助于避免这一问题。.

液体冷却增加了泵、传感器和阀门,所有这些都需要与现有 IT 基础设施的接地和电磁系统兼容。请确保遵循 GB 50057 和 GB 50231 标准,以确保可靠运行。.

3.预算和投资回报预期

改装为液冷数据中心的成本并不低,但从长远来看,它能带来更低的能源成本和更高的密度--这是升级的主要优势。中型数据中心的典型改造成本为原始设施投资的 30-40%,但投资回收期通常为 2-5 年--取决于能源价格和工作负载的密度。您需要在前期成本(硬件、安装、人工)与降低 PUE 和减少维护带来的长期运营节省之间取得平衡。.

常见的气液冷却改造方法

将风冷式数据中心转换为液冷式数据中心没有放之四海而皆准的解决方案,具体选择取决于您的工作负载密度、预算和现有基础设施。以下是三种最常见的方法,复杂程度从低到高排列,旨在帮助您建立一个有效的系统:

1.液气混合冷却

混合系统将用于高密度机架的液体冷却与用于低密度区域的现有空气冷却相结合,非常适合逐步改造。这种方法可以最大限度地减少风险和停机时间,因为您可以只针对发热困难的机架,如人工智能或 GPU 集群,同时逐步过渡到全面冷却设置。.

在高密度机架上安装冷板或后门热交换器,同时为其他设备保留 CRAC/CRAH 设备。液体系统可处理来自关键服务器的大部分热量,而空气冷却则可控制环境温度,从而实现平衡过渡。这种方法对结构的改动最小,而且可以分阶段进行,因此非常适合刚开始使用液体冷却技术的运营商。.

最适合具有混合工作负载密度、前期预算有限或无法完全更换的传统硬件的数据中心--所有这些数据中心都希望在不发生全面中断的情况下进行过渡。.

2.冷板液体冷却

冷板液体冷却是最受欢迎的改造选项,因为它可以与大多数现有的服务器机架配合使用,并能显著改善 PUE,这是任何现代数据中心的首要任务。它将冷板直接安装在服务器 CPU 和 GPU 上,将热量传递给通过闭合回路循环的液体冷却剂,这是许多冷却系统的支柱。.

下面将逐步介绍如何改装冷板系统:

- 评估机架密度和热负荷,以确定需要多少冷板。.

- 安装 CDU(冷却液分配装置),以调节冷却液温度和流量,这对保持系统稳定至关重要。.

- 从 CDU 到每个机架(通常在高架地板下)铺设管道,以连接所有组件。.

- 用冷板取代服务器散热器,并将其连接到管道系统,这是转换过程中的关键步骤。.

- 添加泄漏检测传感器和隔热材料以防止冷凝--这对于符合 GB 50174-2017 标准和确保安全运行至关重要。.

最适合高密度机架(每个机架 15-40 千瓦)、希望将 PUE 降低到 1.2-1.3 的数据中心,以及希望在建立高效系统的同时保留现有服务器的运营商。.

3.浸入式液体冷却

浸入式冷却--将服务器完全浸入介电液中--是对极端热负荷(每个机架 40kW 以上)最有效的方法,但也是最复杂的改造方法。它需要对机架设计和设施布局进行重大改动,因此改造难度更大。.

浸入式冷却的主要改造要求:

- 用适合服务器尺寸的防水浸入式水箱取代标准机架--这是浸入式系统的核心组成部分。.

- 安装流体循环和热交换系统,如热交换器,将介质流体中的热量传递到水中,这对功能性设置至关重要。.

- 修改服务器硬件,移除风扇,确保与介电流体兼容(大多数风冷服务器在这方面需要定制调整)。.

- 增加消防安全系统--电液不易燃,但您仍需遵守 GB 50016 建筑消防规范,以确保设施安全。.

最适合超大规模数据中心、人工智能/高性能计算设施,或计划在进行冷却改造的同时全面升级基础设施的运营商。.

开始改造前的主要考虑因素

改造为液体冷却数据中心需要仔细规划,以避免停机、成本超支和兼容性问题。以下是启动项目前需要解决的最关键问题:

1.停机时间管理

如果计划得当,大多数改造都可以在不关闭整个设备的情况下完成。采用分阶段的方法:从非关键机架开始,测试液体冷却系统,然后转到关键工作负载。混合系统在这方面特别有用,因为它们可以让你在逐个改造机架的同时保持空气冷却系统的运行,确保将对运营的干扰降至最低。.

2.冷却剂的选择

选择符合改装方法和安全要求的冷却剂:

- 水基冷却剂:用于冷板系统具有成本效益,但需要腐蚀抑制剂和泄漏检测,以符合 GB/T 29044 水质标准。.

- 绝缘液体:不导电,非常适合浸入式冷却,但价格较高,需要定期更换。.

3.合规与安全

转换为液冷数据中心必须遵循当地的建筑规范和行业标准,包括 GB 50174-2017、GB 50016 和 ASHRAE 的液冷系统指南。关键的安全措施包括泄漏检测系统、适当的绝缘以防止冷凝,以及与冷却剂类型相匹配的灭火系统--所有这些对于安全、合规的设施都至关重要。.

4.维护和员工培训

液体冷却系统所需的维护与空气冷却不同,您的团队需要接受培训,以监控冷却液液位、检查泄漏以及维护 CDU 和热交换器。行业数据显示,未经培训的员工是导致改装失败的首要原因,因此投资培训以保持系统平稳运行是非常值得的。.

潜在挑战和如何应对这些挑战

改造为液体冷却数据中心并非没有障碍,但只要规划得当,大多数障碍都可以避免。以下是最常见的问题以及如何解决这些问题以实现平稳过渡:

1.兼容性问题

挑战:液冷组件和现有服务器之间的接口不匹配,可能会延误改造。解决方案:在开始之前进行全面的硬件审核,与提供兼容性测试的供应商合作,优先使用标准化组件(如新兴行业准则所建议的),以确保组件无缝协作。.

2.泄漏风险

挑战:液体泄漏会损坏 IT 设备并导致停机。解决方案:安装多级泄漏检测系统(服务器级、机架级和设备级),使用高质量的管道和配件,并培训员工在发生泄漏时迅速做出反应--这对保护设备至关重要。.

3.成本超支

挑战:意外的结构升级或硬件更换会导致成本增加。解决方案:预先进行详细的现场评估,预留应急基金(占项目总成本的 10-15%),并采用分阶段的方法将成本分摊到各个时间段,帮助您保持在预算范围内。.

结论:您是否应该改造风冷数据中心?

将现有的风冷式数据中心改造为液冷式数据中心不仅可行,而且通常还是一项明智的投资,尤其是在您面临热负荷上升、能源成本高昂或计划扩展人工智能或高性能计算等工作负载的情况下。关键是要根据您的密度需求、预算和现有基础设施,选择正确的改造方法(混合、冷板或浸入),以建立一个满足您业务目标的系统。.

翻新项目的下一步工作: 翻新项目的下一步工作

- 与液体冷却供应商预约免费的可行性评估,以了解您的设施是否适合进行转换。.

- 审核现有硬件,找出兼容性问题和需要更换的硬件。.

- 制定分阶段改造计划,明确时间表、预算和策略,最大限度地减少停机时间。.

- 对您的团队进行液体冷却维护和安全协议方面的培训,以保持系统平稳运行。.