本指南将从资深技术角度,为您讲解如何计算数据中心制冷负荷需求。

如果您曾经管理过数据中心,就会知道平衡冷却性能和成本的压力有多大。我也曾有过这样的经历:盯着比 ASHRAE 建议极限温度高出 5°F 的服务器机架,怀疑数据中心冷却系统是否过小......或者我是否只是在一个过大的系统上浪费能源。事实上,计算数据中心的冷却负荷并不是简单地将数字填入公式,而是要了解您独特的设施、IT 设备以及使每个数据中心与众不同的实际因素。.

冷却故障是造成数据中心停机的最常见原因之一--美国正常运行时间研究所(Uptime Institute)的 2025 年报告发现,在所有意外停机时间中,冷却故障占 14-19%。根据同一份报告,一旦停机,中型设施平均每分钟的损失为 $9,000。另一方面,过大的冷却系统会浪费 20-30% 的能源预算,侵蚀利润并增加碳足迹。.

因此,我根据 8 年来从小型主机代管空间到企业级设施等各种规模数据中心的管理经验,编写了本指南。我们将采用黄金标准:ASHRAE 的《数据处理环境热指南》,以及 TIA-942 标准的见解,一步步指导您完成计算过程。没有繁琐的术语,没有随意的数据堆砌,只有适用于现实世界场景的实用、可操作的建议。.

什么是数据中心的冷却负荷?

让我们从最基本的开始--因为我发现即使是经验丰富的团队有时也会把 “冷却负荷 ”和 “冷却能力 ”搞混。简单地说,数据中心的冷却负荷是指为确保数据中心有效冷却以保证 IT 设备安全运行而需要从设备中排出的热量总量。这不仅与温度有关,还与平衡显热和潜热有关,而显热和潜热都会影响硬件的使用寿命和性能。.

美国采暖、制冷和空调工程师协会(ASHRAE)制定了数据中心运行条件的全球标准,如果您想避免设备故障,他们的指导原则是不容置疑的。以下是您需要记住的内容(我已将其贴在办公室墙上,以便快速参考):

- 温度范围:18-27°C (64-80°F) - 我发现将温度保持在 24°C (75°F) 左右最能兼顾设备安全和能源效率。.

- 相对湿度:40-60% RH - 太干,有静电风险;太潮,敏感元件上会有冷凝水。我曾经有一个位于沿海地区的小型数据中心忽视了这一点,结果我们因水渍而更换了三台服务器。.

- 露点:-9-15°C - 这一点经常被忽视,但它对防止冷通道结露至关重要。.

在大多数数据中心,显热占总冷却负荷的 70-80%,而潜热占剩余的 20-30%(根据 ASHRAE 的《基本手册》第 18 章)。这意味着您的数据中心冷却系统需要优先考虑温度控制,但也不能忽视湿度--湿度对数据中心的可靠冷却至关重要--尤其是在极端天气地区。.

不可忽视的热源

刚开始计算制冷负荷时,我犯了一个错误,那就是只关注 IT 设备。剧透:这是灾难的根源。IT 设备确实产生了数据中心 80-90% 的热量,但其他 10-20% 的热量来自容易被忽视的来源,所有这些来源都会影响数据中心的冷却需求。让我们以我的实际经验为例,对每个热源进行分析:

1.IT 设备负载

这是计算制冷负荷的基础。服务器、存储阵列、网络交换机--所有这些设备都会将 100% 的电能转化为热量。没错:如果一台服务器使用 500W 的电能,就会产生 500W 的热量。这是一个 1:1 的比例,没有商量的余地。.

建议:不要只使用设备的 “铭牌功率”。我见过一些团队这样做,结果导致规模不足。铭牌功率是设备可以使用的最大功率,但实际上,大多数服务器的运行功率为该功率的 60-80%。使用电源监控工具获取实时功耗数据,这将使您的计算更加准确。.

2.照明负载

LED 照明是大多数现代数据中心的标准配置,其效率远高于老式荧光灯,但仍会产生热量。经验法则是 5-10 瓦/平方英尺(54-108 瓦/平方米)。对于一个 1,000 平方英尺的数据中心来说,这相当于 5,000-10,000 瓦的热量,如果忘记将其计算在内,足以让一个小型冷却装置超负荷运转。.

我有一个惨痛的教训:有一次,一个客户将他们的数据中心扩大了 500 平方英尺,并增加了 LED 照明,他们忘记了这将增加数据中心的冷却需求,但却忘记将其计入冷却负荷。一周之内,他们的 CRAC 设备就达到了 100% 的容量,服务器也开始出现故障。在计算中增加 2,500 至 5,000 瓦的功率后,问题迎刃而解。.

3.乘员负荷

人也会产生热量--即使您的数据中心大部分时间无人值守。根据 ASHRAE 的估算,每个用户的发热量为 400 BTU/h (117 W)。这看似很小,但如果有 5 名技术人员每天在数据中心工作 8 小时,那么额外产生的热量就是 5 × 400 × 8 = 16,000 BTU/h。对于小型数据中心来说,这可能会产生明显的差别。.

4.电力基础设施供热

您的 UPS、PDU 和开关设备并不是 100% 高效的--它们会以热量的形式损失能量。以下是我在实践中的发现(与 ASHRAE 数据一致):

- UPS 效率低下:IT 负载的 5-10%。如果 IT 负载为 100 千瓦,则 UPS 将产生 5-10 千瓦的热量。.

- PDU/switchgear 损耗:IT 负载的 2-3% 损耗。对于同样的 100 千瓦 IT 负载,这又是 2-3 千瓦的热量。.

这是另一个常见的疏忽。我曾为一个数据中心工作过,该数据中心的 IT 负载为 200 千瓦,但却忘记将 UPS 和 PDU 的损耗计算在内--结果他们的冷却系统功率不足 14 千瓦。在经历了夏季热浪和几次服务器故障后,他们才意识到自己的错误。.

5.建筑围护结构热增益

数据中心的墙壁、屋顶和窗户会从外部透入热量--透入多少取决于气候。ASHRAE 建议大多数地区采用 0.15-0.25 kW/m²。在炎热、阳光充足的地区,建议值接近 0.25 kW/m²;在气候凉爽的地区,建议值约为 0.15 kW/m²。.

屋顶隔热是关键。如果屋顶没有适当隔热,热增量就会大大增加。我曾经将一个数据中心的屋顶隔热材料从 R-10 升级到 R-30,这样就减少了 40% 的围护结构热增量,大大节省了制冷成本。.

6.新风补给负荷

大多数数据中心都需要新鲜空气进行通风(以保持空气质量并满足规范要求)。室外空气中的热量会增加制冷负荷,而且会根据室外温度和引入的新鲜空气量而变化。例如,如果您在 35°C (95°F) 的温度下引入 1,000 CFM 的室外空气,而数据中心的温度为 24°C (75°F),则需要去除大量的额外热量。.

逐步计算制冷负荷

在介绍了热源之后,让我们来看看我每次审核数据中心时都会使用的计算过程。该方法基于 ASHRAE 标准,但我对其进行了简化,以便在现实世界中使用--无需高级工程学位。首先,我们先来看看单位换算:

- 1 千瓦 = 3.412 英制热量单位/小时(这是最重要的一项,请牢记!)。

- 1 吨制冷 (TR) = 12,000 BTU/h(冷却设备通常以吨为单位,因此这对设备选择至关重要)

- 总制冷负荷(千瓦)= IT 负荷 + 非 IT 热增益 + 安全系数

步骤 1:计算 IT 设备热负荷

从 IT 负载开始--这是基线。正如我前面提到的,使用实时功耗数据,而不是铭牌功耗。计算公式如下

IT 负荷(BTU/h)= IT 总功率(千瓦)×3.412

举例说明:如果 IT 设备的实时功率为 100 千瓦(非铭牌功率),则 IT 热负荷为 100 × 3.412 = 341,200 BTU/h。这个数字很大,但它是计算的基础。.

专业建议:如果没有实时功率监控,请使用 “铭牌功率 × 0.7 ”的经验法则。大多数服务器的运行功率为铭牌功率的 70%,因此如果没有更好的数据,这是一个安全的估计值。.

第 2 步:计算非 IT 热负荷

现在,将我们讨论过的所有二次热源加起来。我们还是以 100 千瓦的 IT 负载为例进行具体说明:

- 照明:假设您的数据中心面积为 1,000 平方英尺,使用 7 W/ft²(ASHRAE 范围的中间值),即 1,000 × 7 = 7,000 W = 7 kW。转换为 BTU/h7 × 3.412 = 23,884 BTU/h。.

- 入住人员:3 名技术人员每天工作 8 小时。3 × 400 BTU/h = 1,200 BTU/h(我们不乘以小时数,因为制冷负荷是按小时计算的)。.

- 电气损耗:不间断电源(IT 负载 8%)+ PDU(IT 负载 2%)= 总计 10%。100 kW × 0.10 = 10 kW = 34 120 BTU/h。.

- 建筑围护结构:1,000 平方英尺 = 92.9 平方米。以 0.20 kW/m² 计算(平均气候),即 92.9 × 0.20 = 18.58 kW = 63,395 BTU/h。.

- 新鲜空气:假设您引入了 1,000 CFM 的室外空气,温度为 30°C(86°F)。根据 ASHRAE 的新风得热公式,这将增加约 5 kW = 17 060 BTU/h(具体数字取决于室外湿度,但对于大多数地区来说,5 kW 是一个安全的估计值)。.

非 IT 负荷总量 = 23,884 + 1,200 + 34,120 + 63,395 + 17,060 = 139,659 BTU/h(或 40.93 kW)。.

步骤 3:增加安全和增长保证金

这是区分优秀计算和卓越计算的关键步骤。数据中心会不断扩大,IT 设备会不断增加,功率密度会不断提高,还会出现意想不到的热源。ASHRAE 推荐的安全系数为 10-20%,但我认为应该更加保守,尤其是对于关键任务设施。.

对于大多数数据中心:20% 余量。对于关键设施(如托管金融或医疗保健数据的设施),Uptime Institute 建议采用 25% 余量。让我们以 20% 为例:

负荷小计(BTU/h)= IT 负荷 + 非 IT 负荷 = 341,200 + 139,659 = 480,859 BTU/h。.

安全系数 = 480 859 × 0.20 = 96 172 BTU/h。.

步骤 4:最终尺寸和单位换算

现在,加上安全系数,得出总制冷负荷,然后换算成吨(大多数制冷设备的单位):

总制冷负荷(BTU/h)= 480,859 + 96,172 = 577,031 BTU/h。.

总制冷负荷(吨)= 577,031 ÷ 12,000 = 48.08 吨。.

因此,对于这个 IT 负载为 100 千瓦的数据中心,您需要一个额定功率约为 48 吨的冷却系统。我总是四舍五入到最接近的整数(本例中为 50 吨),以考虑到任何意外的热增量--多一点容量总比不够好。.

影响计算的关键因素

计算制冷负荷并不是一个一劳永逸的过程。一不小心,有几个因素就会影响计算结果。以下是我学会注意的几个因素:

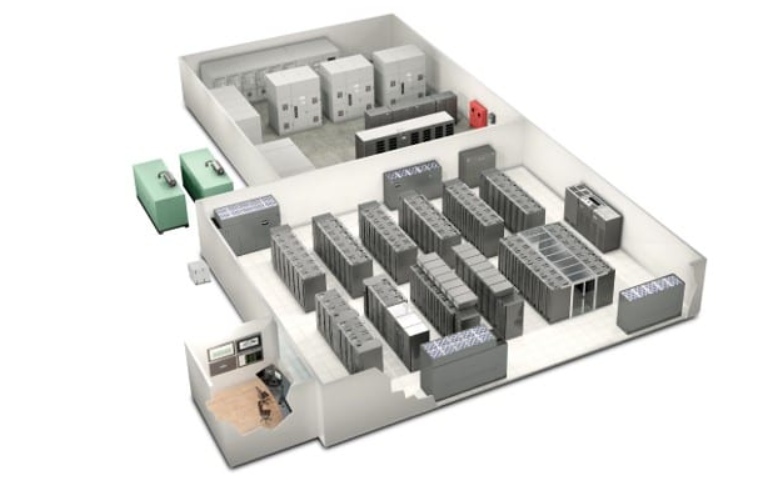

1.机架功率密度

机架密度是指每个机架的功率(千瓦/机架),它是影响数据中心冷却负荷的最大因素之一,直接决定了数据中心的冷却需求。低密度机架(5-10 千瓦/机架)很容易使用标准的 CRAC/CRAH 系统进行冷却。但高密度机架(20-50 千瓦/机架)(常见于云数据中心或人工智能设施)则需要专门的冷却系统,如液体冷却或后门热交换器。.

我曾与一个客户合作,该客户的机架密度为 30 千瓦/架,但却试图使用标准的 CRAC 设备。结果呢?机架出现热点,服务器节流,冷却系统频繁报警。我们不得不升级到后门热交换器,这在冷却负荷计算中增加了 15%,但为了保证设备安全,这样做是值得的。.

2.用电效率(PUE)

PUE 是数据中心总能耗与 IT 能耗的比率。PUE 为 1.0 意味着所有能源都用于 IT 设备(现实生活中不可能),而 PUE 为 2.0 则意味着一半能源用于冷却和其他非 IT 系统。冷却系统的能耗通常占数据中心总能耗的 30-50%,因此较低的 PUE(1.2-1.4)意味着冷却负载浪费较少。.

如果您的 PUE 较高(超过 1.5),则表明您的冷却系统效率低下,可能是气流管理不善,或者是系统过大。修复 PUE 可以将数据中心的冷却负荷降低 10-20%,从而提高数据中心的冷却效率。.

3.气候和环境温度

地理位置比你想象的更重要。在炎热潮湿的地区(如佛罗里达州或德克萨斯州),您会有更高的围护结构得热量和更多的潜热需要去除。在气候寒冷的地区(如加拿大或阿拉斯加),您可以使用自由冷却(也称为 “经济模式”),在冬季将制冷负荷降低 30-60%。.

我曾在明尼苏达州管理过一个数据中心,在冬季,我们使用了 80% 的免费冷却,这使我们的冷却成本降低了 50%,冷却负荷减少了 40%。如果您所在的地区气候寒冷,请不要忘记将免费制冷计算在内,它可以为您节省大量资金。.

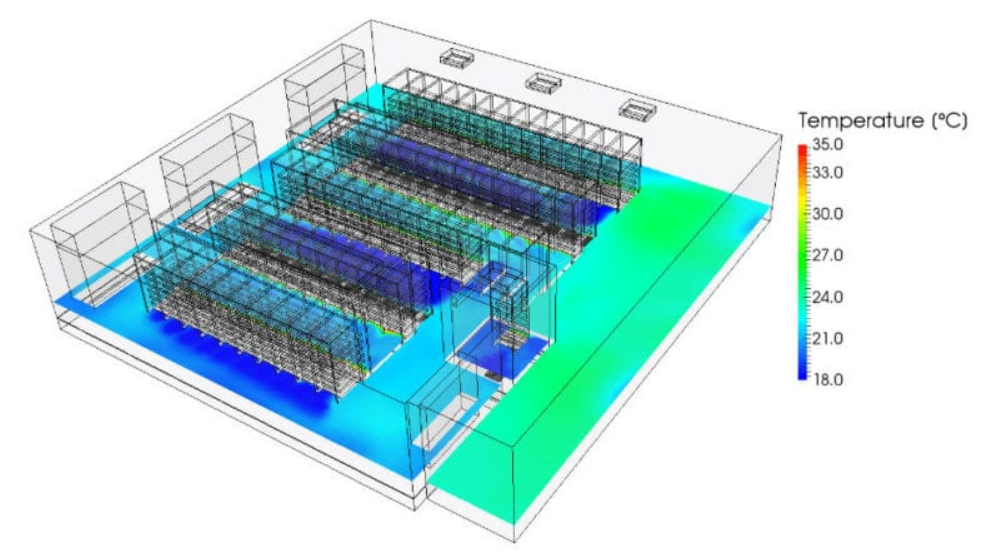

4.气流管理

气流不畅是高效冷却的大敌。冷热通道隔离是 ASHRAE 的最佳实践,可减少 15-25% 的冷却负荷。我见过没有隔离措施的数据中心,有 30% 的冷却空气被浪费掉(在到达服务器之前与热空气混合)。.

如果不使用隔热箱,您的制冷负荷计算就会出现偏差--您需要更多的制冷量来补偿浪费的空气。投资密封系统是降低制冷负荷和节约能源的最简单方法之一。.

应避免的常见错误(我都犯过)

即使是最有经验的团队,在计算制冷负荷时也会犯错。以下是我经过多年试验和错误总结出的避免错误的方法:

- 低估 IT 负载的增长:计划 3-5 年的扩展。我曾经为一个客户计算过冷却负荷,但该客户只计划了 1 年的增长--在 18 个月内,他们需要增加一台冷却设备,这让他们多花费了 $50,000 美元。.

- 忽略安全系数:为了省钱而偷工减料是很诱人的,但从长远来看,缺少安全系数会让你付出更大的代价。我曾见过一个没有安全系数的数据中心,在夏季的热浪中不得不关闭 10 台服务器以避免过热。.

- 忽略气流设计:热点会使冷却负荷计算变得毫无意义。即使总负荷正确,气流不畅也会导致过热。在计算负载时,一定要将气流管理(如密封)考虑在内。.

- 使用舒适冷却 HVAC:舒适冷却系统(如办公室内的冷却系统)不是为数据中心设计的。它们循环开启和关闭,可能会导致温度波动,而且它们也不是为处理持续热负荷而设计的。始终使用数据中心专用冷却设备(CRAC/CRAH 设备、液体冷却)。.

- 忘记更新计算:随着设备的增加、基础设施的升级或设施的改变,制冷负荷也会发生变化。我每 6 个月更新一次计算结果,这样就能确保冷却系统的尺寸始终正确。.

结论

通过遵循 ASHRAE 标准、考虑所有热源并增加安全系数,可以避免数据中心制冷的两大隐患:规模不足和规模过大。.

根据我的经验,最好的计算是数据与实际洞察力的结合。使用工具,按照步骤操作,但也要相信自己的直觉--如果感觉有什么不对劲(比如冷却系统以 100% 的容量运行),请仔细检查您的数字。对于关键任务设施,一定要与经认证的 MEP 工程师合作,他们可以帮助您调整计算结果,避免代价高昂的错误。.

归根结底,可靠的数据中心冷却就是平衡:平衡散热与能效,平衡当前需求与未来增长,平衡数据与实际经验。有了这本指南,您就能满怀信心地计算制冷负荷,并在任何情况下保持数据中心的平稳运行。.